Une brève histoire d'intelligence, de conscience et d'éthique

Conférence donnée lors de la réunion de la Conférence nationale des Académies (C.N.A.), à Caen, en octobre 2022, par Jean Richert et Charles Hirlimann

1 Introduction

L’Intelligence artificielle (IA) est née dans la seconde moitié du siècle dernier. Fille de la logique et des mathématiques, elle s’est développée depuis, et ses applications ont investi tous les domaines et secteurs des sciences, de la technique et de la vie, grâce aux progrès fulgurants de la puissance des ordinateurs actuels.

Cette dissertation veut rappeler les circonstances de son apparition, son contenu et ses potentialités, puis esquisse son impact sur le plan social, économique et politique, évoque les effets éthiques de ses applications sur le comportement des individus et des sociétés.

2. L’histoire de la numérisation de la logique base des mathématiques est portée par trois noms : David Hilbert, Kurt Gödel et Alan Turing

C’est dans un contexte politique et social très troublé, à savoir la première moitié du 20e siècle, que s’est produit un événement de première importance dans le monde des

mathématiques, à savoir la réponse à la question de la consistance logique desdites mathématiques, leur cohérence, l’absence de possibles contradictions, un problème fondamental posé par le

mathématicien allemand David Hilbert et non encore élucidé à cette époque.

La réponse à cette question fut apportée en 1930 lors d’une conférence inter-nationale par le logicien et mathématicien Kurt Gödel, un autrichien né à Brno en Tchéquie, formé à Vienne et installé aux

Etats-Unis à partir de 1948. Ce chercheur s’attaqua à la question posée pour prouver qu’en fait, énorme déception pour la communauté, la réponse est négative ! Cette consistance n’existe pas et

cette constatation n’a jamais pu être contredite.

Ce qui nous intéresse ici aujourd’hui c’est la démarche utilisée par Gödel pour arriver à ce résultat, à savoir une méthode d’approche toute nouvelle, originale et révolutionnaire pour l’époque : la

numérisation des propositions de la logique sur laquelle les mathématiques sont fondées, c’est-à-dire une opération qui consiste à traduire l’énoncé des propositions de la logique en termes

d’opérations sur des nombres qui permette de mener à la réponse à une question posée. Cette idée a priori inattendue fut le point de départ de la révolution numérique.

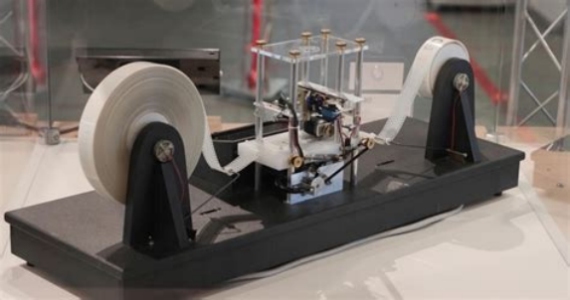

Les démonstrations de Gödel se sont faites à la main, avec papier et crayon. Sa méthode d’approche révolutionnaire fut une source d’inspiration pour un jeune mathématicien anglais Alan Turing. Celui-ci conçut une machine virtuelle, un instrument traduisant des informations logiques enregistrées en langage numérique binaire (des 0 et des 1) sur une bande de papier dont l’évolution est guidée par les commandes d’un opérateur qui gère le déplacement de cette bande en fonction des instructions logiques données par un programme fixé (une procédure de calcul).

À la main, là encore, Turing s’attaqua au problème particulier qui faisait partie du questionnement de Hilbert, à savoir : est-il TOUJOURS possible de déterminer si une assertion (affirmation)

dont la réponse est encore inconnue, ce que l’on appelle une conjecture, est vraie ou non (on parle du test de l’indécidabilité d’une conjecture) ? La réponse fut celle donnée par les travaux

analytiques de Gödel, elle fut négative.

Exemple de problème lié à la logique, base des mathématiques : le paradoxe bien connu du crétois menteur qui dit : « Je mens» : si c’est vrai, alors ce qu’il dit est faux, mais si

ce qu’il dit est faux, c’est qu’il dit la vérité.

Le fonctionnement de cette machine primitive, sortie de l’imagination d’un homme, fut à l’origine du principe de calcul automatique de l’ordinateur moderne qui exécute, de façon programmée par son utilisateur, une suite d’ordres donnés en langage clair et rend une solution en langage clair qui est lisible et interprétable par l’utilisateur. .

3. Les sciences cognitives et la cybernétique

Ces développements, à savoir la question de Hilbert, les résultats de Gödel, les travaux de Turing, eurent un retentissement sans précédent dans la communauté intellectuelle des sciences dites cognitives du début des années 1940, c’est-à-dire dans les mondes de la philosophie, la psychologie, les neurosciences, la linguistique, l’anthropologie.

Une activité intense se développa aux États-Unis : à partir de 1942 se mirent en place à New-York les " conférences Macy" (1942 – 1953), conçues comme un lieu d’échanges d’idées en vue de définir un rapprochement entre différents domaines du savoir destinés à faire progresser la connaissance de l’homme et de ses potentialités.

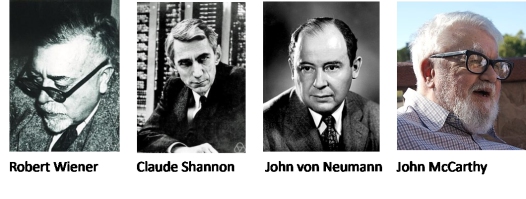

Ainsi se rencontrèrent les sommités de l’époque séjournant aux Etats-Unis : des mathématiciens et des physiciens célèbres, pour une grande part immigrés aux États-Unis, tels que Norbert Wiener, Claude Shannon et John von Neumann, ainsi que de nombreuses autres personnalités connues pour leurs travaux et intéressées par la réalisation de ce qui allait devenir plus tard l’ordinateur digital opérationnel.

Ainsi naquit la « cybernétique », expression d’origine grecque trouvée chez Platon qui signifie « pilotage de navire » et utilisée pour la première fois par Ampère (1834).

Cette science nouvelle se divisa cependant très vite, à la fin de la guerre (après 1946), en trois branches distinctes, dont une des branches consista dans la contribution particulière de Marvin

Minsky qui construisit en 1951, au Massachussetts Institute of Technology (MIT), la première machine dotée d’un système d’apprentissage logique qui sera décrit plus loin. En 1959 il fonda

le

MIT Artificial Intelligent Project avec John Mc Carthy qui fut, en 1956, à l’origine de la dénomination « Artificial Intelligence » : ainsi naquit l’intelligence artificielle,

que l’on peut considérer comme l’héritière directe des travaux de Turing.

4. L’intelligence artificielle

L’intelligence artificielle est, en pratique, un programme informatique implanté dans un ordinateur destiné à établir par lui-même toutes sortes de corrélations entre des objets

d’un type donné (images, photos, sons, systèmes de contrôle, etc.).

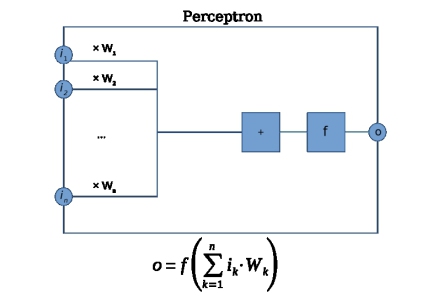

Ce programme est écrit en langage numérique (des 0 et des 1) suivant le principe de la numérisation introduite par Gödel et Turing. Il est constitué d’éléments simples de calcul, appelés

« perceptrons », (ou neurones en référence au cerveau) suivant un concept introduit en 1957 par Frank Rosenblatt, un psychologue du Laboratoire d’aéronautique de l’Université Cornell aux

Etats-Unis.

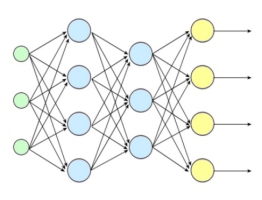

Figure 4. Ci-dessus, schéma de principe du circuit électronique d’un perceptron. On donne plus ou moins d’importance aux signaux électriques i (input, entrée) en les multipliant par un coefficient W (weight, poids) plus ou moins fort. Les signaux obtenus sont tous additionnés, puis une fonction « f » ad hoc est appliquée à la somme. Pour un jeu d’entrées « i », les poids « W » sont ajustés jusqu’à obtenir un signal de sortie « o » (outpout, sortie) conforme au résultat attendu. Ce contre, schéma symbolique d’un perceptron.

Un perceptron reçoit des informations numérisées à son entrée « i », il les transforme à l’aide d’une fonction spécifique du sujet traité en un signal de sortie « o » après que les différentes composantes de l’entrée aient été pondérées par les coefficients « w » (Figure 4).

Les perceptrons sont assemblés en réseaux auxquels on applique un signal et on souhaite qu’après la traversée du réseau ce signal prenne une forme définie à l’avance. Pour cela on modifie la valeur des paramètres « w » jusqu’à ce que le signal de sortie soit le plus proche possible du signal voulu (la fonction « f », de grande importance, ne joue pas de rôle dans ce processus). Pour améliorer la qualité de ce traitement, on répète l’opération en superposant plusieurs réseaux de perceptrons connecté entre eux (Figure 5).

On notera que cette démarche mime le fonctionnement du traitement du signal lumineux dans l’empilement de couches de neurones de la rétine de l’œil, de là vient l’appellation de « réseau

de neurones » donnée aux réseaux de perceptrons. Des logiciels annexes réalisent l’optimisation des paramètres « w » et on obtient ainsi des taux de précision sur la réponse qui

peuvent dépasser 99 % de la réponse attendue.

Cette phase de modification des paramètres « w » est nommée la phase d’apprentissage. Prenons un exemple. On souhaite construire un logiciel capable de reconnaître des photos de chats. Pour cela on introduit des photos numériques d’animaux à l’entrée de l’empilement de réseaux de neurones logiciels et on attend en sortie un « 0 » ou un « 1 » qui dise si oui ou non la photo présentée est celle d’un chat. Pendant la phase d’apprentissage un superviseur indique au logiciel si sa réponse est juste ou pas, à chaque présentation d’une photo d’un animal, afin qu’il puisse modifier la valeur des paramètre « w » en conséquence. Dans l’état actuel de la technique, on sait écrire pour certains problèmes des logiciels superviseurs qui rendent l’opération entièrement automatique donnant ainsi accès au traitement de gigantesques bases de données.

Si le nombre de couches intermédiaires du programme est petit (1 ou 2), on parle d’apprentissage machine, tandis que l'on parle d’apprentissage profond (le fameux deep learning, DL) s’il est grand (allant jusqu’à des centaines ou même des milliers dans les programmes élaborés récents).

Ce but étant atteint, le programme ainsi préparé peut être utilisé ultérieurement pour traiter n’importe quel objet du même type, mais seulement celui-là : le programme géré par l’ordinateur sera alors dit « intelligent ».

Un peu de sémantique

- Intelligence signifie ici capacité de générer et de gérer la reproduction d’un objet ou d’une action.

- la qualification « artificielle » a été introduite pour dire que cette intelligence se développe en dehors de l’homme, elle est le prolongement du cerveau comme tout autre outil créé par l’homme.

- on remarquera qu’un programme IA est un outil et non un générateur de concepts nouveaux.

- à méditer : les paroles de John Mc Carthy, le créateur du nom : « Dès que ça marche, plus personne n’appelle cela de l’IA ».

5. Développements actuels de l’IA

La technique du DL (apprentissage profond), qui est universelle, dans la procédure d’utilisation actuelle de l’IA s’est considérablement développée grâce à l’augmentation continuelle de la puissance des ordinateurs et à l’ingéniosité de ses utilisateurs.

L’IA a ouvert la voie à de nombreuses applications de plus en plus avancées, exigeant des capacités de mémoire de calcul de plus en plus grandes et une programmation de plus en plus complexe.

Ainsi est-on, entre autre, capable aujourd’hui, en accroissant conséquemment le nombre de neurones, de traduire des textes de langue à langue avec une qualité devenue acceptable, d’augmenter la précision et la taille des objets à reproduire, de reproduire des sons, de prendre en compte le paramètre temps (guidage d’engins mobiles terrestres et aériens), de prévoir le temps et même de faire gérer par l’ordinateur lui-même la coexistence de programmes qui avancent en parallèle (le générateur et le discriminateur) et sont entraînés pour se corriger mutuellement de façon automatique (2020). Actuellemnt apparaissent les premiers logiciels démonstrateurs de théorèmes mathématiques !

6. Esquisse de l’état actuel et prévisible de l’IA, ses conséquences

Ainsi l’IA a-t-elle investi tous les domaines de la vie des individus des sociétés modernes. Pour en citer quelques-uns :

- en science fondamentale : des simulations qui permettent de reproduire des processus physiques, chimiques et biologiques complexes (exemple très récent : la réplication du mécanisme de repliement de protéines complexes, considéré comme le meilleur travail de recherche de l’année 2021 par les revues Nature et Science)

- en technologie : la mise au point de processus qui permettent de gouverner l’automatisation d’opérations complexes (robotisation, guidage automatique,..).

- en économie, finances et emploi : la gestion de problèmes organisationnels nécessitant des changements rapides dans un contexte de forte concurrence, où des compétences « pointues » s'imposent.

- au service de la santé et du bien-être : l’augmentation de la qualité des diagnostics et des traitements médicaux, de l’imagerie médicale, de la chirurgie, de la virologie,..

- dans le secteur de la protection de la nature : les moyens de surveillance et de régulation plus performants pour éviter les catastrophes naturelles.

- dans le secteur des arts et de la culture : des travaux d’art combinant l’apport d’un artiste et celle d’une contribution de l’IA : voir la mise en place un programme national, « L’Intelligence Artificielle au service de l’humain », en 2018.

L’utilisation de l’IA présente cependant une face négative

Pour citer quelques aspects :

- elle contribue au problème mondial de la consommation croissante d’énergie.

- elle a fait naître des monopoles internationaux concepteurs de moyens informatiques de plus en plus performants, et de ce fait, capables parfois de se dresser contre les pouvoirs politiques et publics.

- elle menace l’existence d’un grand nombre de types d’emplois.

- elle suscite la mise en place d’une criminalité digitale dirigée contre les entreprises et les Etats et à la prolifération du mensonge

- elle a tendance à générer une société de communication limitée à l’addiction au smartphone, en particulier dans les jeunes générations qui communiquent très souvent avec ce genre d’outil et oublient le contact humain.

7. En conclusion

L’intelligence artificielle est unanimement reconnue comme un concept remarquable créé par le génie de quelques-uns, qui peut trouver des applications pour tout ce qui concerne l’homme et ses

besoins, l’ouverture à un monde nouveau.

Mais tout nouveau développement et toute découverte peut avoir deux faces. Il ne faudrait pas que certains progrès mènent la société humaine dans un état de conscience morale individuelle et sociale

dégradée et au rejet d’une éthique menant à l’apaisement de tensions sociales exacerbées. L’homme se doit de respecter l’homme et la nature. Les connaissances et leurs applications acquises grâce aux

progrès techniques doivent être utilisées pour y contribuer.